本文第一作家闫峻溪为清华大学 FAITH Lab 预科博士生,师从詹靖涛助理老师。FAITH Lab(Foundation of AI Lab at TsingHua)由詹靖涛老师创立,奋力于于探索东说念主工智能的基开心趣,旨在揭示智能系统背后的底层端正。实验室附庸于清华大学信息检索研究组(THUIR),研究标的涵盖大说话模子的表面基础与范围化端正。

范围定律(Scaling Law)一直是大说话模子成立的中枢率领用具。从 Kaplan 等东说念主忽视的经典幂律联系,到 Chinchilla 团队对最优老师计谋的计议,业界酿成了共鸣:跟着模子参数目的增长,交叉熵亏空会以可展望的幂律速度捏续着落。

可是,越来越多的研究者脱手发现令东说念主不安的时局:交叉熵范围定律在超大模子上失效了。亏空的着落从幂律展望偏移,这让依赖Scaling Law来率领百亿甚而千亿参数模子老师的团队措手不足。

来自清华大学的研究团队在一篇发表在ICLR 2026上的论文中,对这一问题给出了一个颇具知极力的回应:交叉熵亏空本人并不委果征服范围定律;委果scale的,是它里面一个覆盖的要素。

研究团队忽视了一种全新的交叉熵明白枢纽,将其拆分为三个部分:罪状熵(Error-Entropy)、自对都(Self-Alignment)和置信度(Confidence)。通过在多个数据集上对 32 个模子进行系统实验,他们发现只须罪状熵严格征服幂律缩放,其余两项基本不随模子增大而变化。这一发现不仅为交叉熵范围定律失效提供了新的讲解注解,也为大模子的老师和表面研究提供了一个更可靠的度量基准。

论文地址:https://arxiv.org/abs/2510.04067

开源代码:https://github.com/yanjx2021/RethinkCE

拆解交叉熵:从名次启程的新视角

为什么交叉熵范围定律会在大模子上失效?论文的中枢不雅点是:交叉熵本人是一个"搀杂度量",其中只须一部分委果随模子范围改善,另外的部分则酿成了滋扰。要看清这少许,需要把交叉熵拆伙。

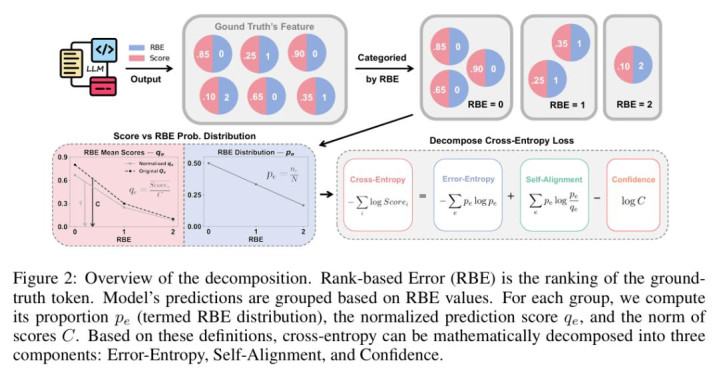

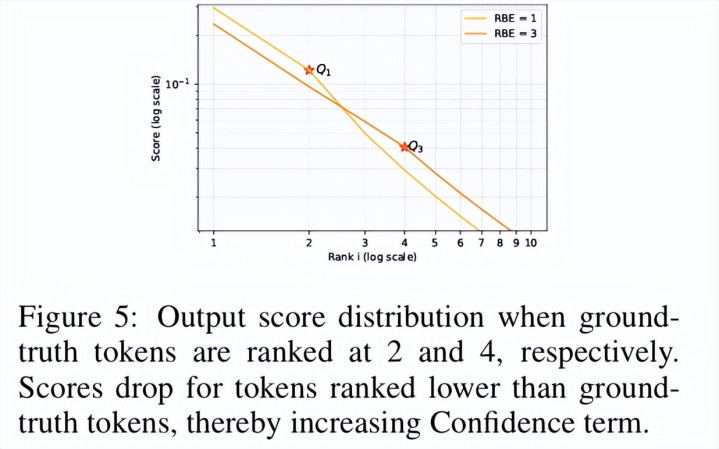

研究者为此忽视了一个新策画:基于名次的罪状(Rank-based Error, RBE)。与交叉熵关心正确 token 的概率得分不同,RBE 平直斟酌正确 token 在模子输出中的名次位置。举例,要是有 4 个 token 的得分高于正确谜底,那么 RBE 就就是 4。

选用名次而非概率,是因为概率值很容易被推理阶段的后处置操作(如温度缩放、top-k 采样)所改造,但 token 之间的相对排序不会被影响。因此,名次是一个更为郑重的模子才智策画。

罪状熵(Error-Entropy):斟酌 RBE 分散的香农熵。优化模子会让正确 token 尽可能排在前边,即模子学会「别离对错」。当模子通盘不知说念哪个 token 正确时,RBE 分散接近均匀分散,此时罪状熵最大。

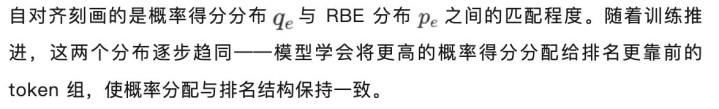

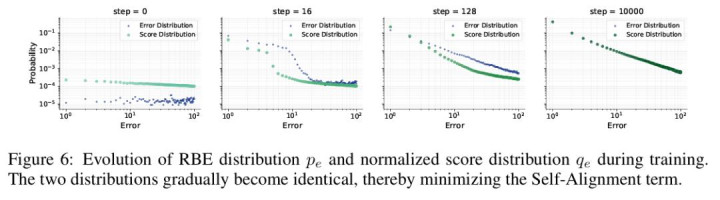

自对都(Self-Alignment):描绘模子概率得分与 RBE 分散之间的对都进程。优化这一项,条款模子给名次越高的 token 分派越高的概率,使概率分散与名次分散保捏一致。

置信度(Confidence):反馈模子输出概率得分的举座大小,优化这一项意味着模子举座输出的分数更自信。

老师动态考证

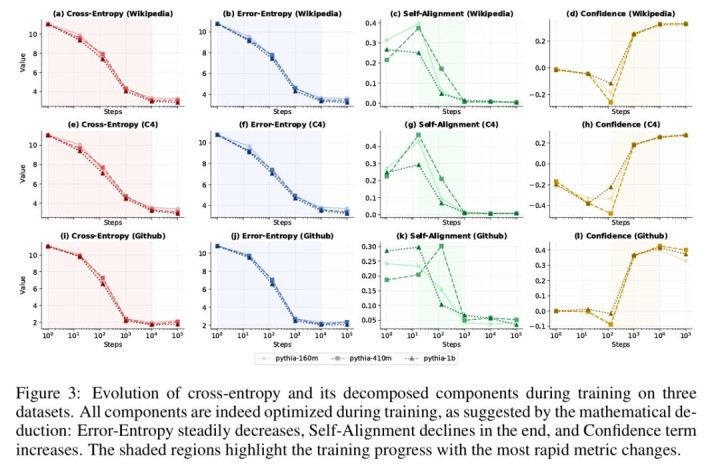

论文通过不雅察完竣老师流程来考阐明白的合感性。实验暴露,三个要素在老师中呈现出了了的优化步履:模子在老师早期领先陆续镌汰罪状熵,在其着落一段本事之后才脱手权贵优化自对都和置信度运转。

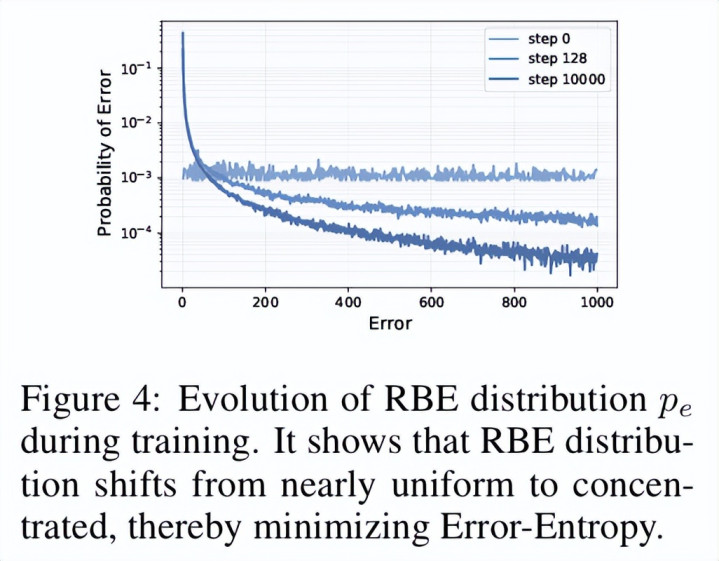

进一步深远每个要素的细节:在老师初期,RBE 分散接近均匀,模子对哪个 token 正确简直一无所知,比赛下注app官方网站名次近乎立时。跟着老师鼓励,RBE 分散缓缓向头部陆续,正确 token 被越来越多地排到前方,罪状熵因此捏续着落。

置信度方面,名次低于正确 token 的候选词得分在老师中被系统性压低,正确与伪善 token 之间的分数差距不休拉大。模子在学会排序之后,进一步学会了"拉开差距"。

值得详确的是,自对都和置信度都与概率数值密致有关,而罪状熵平直描绘排序准确度(不受采样计谋影响),是三者中最能诚恳反馈模子确切性能的要素。

只须罪状熵在缩放

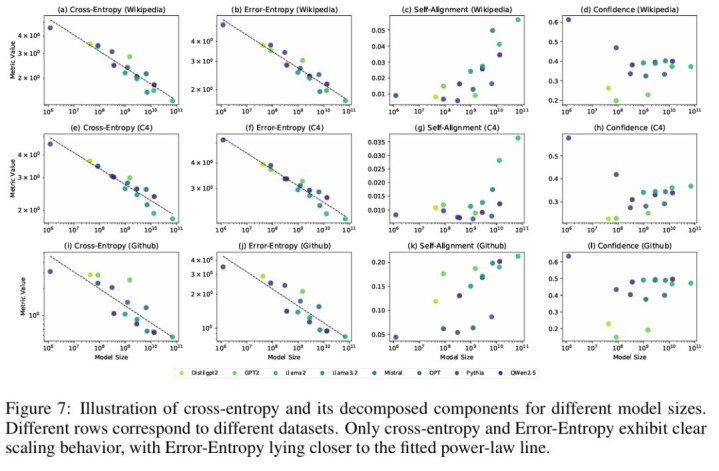

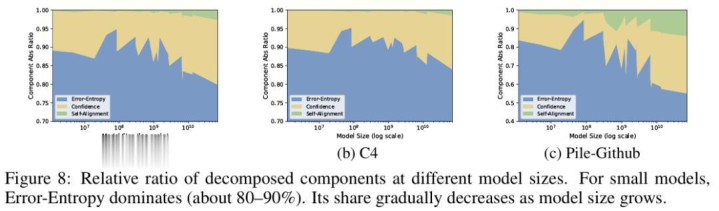

研究者进一步在 Wikipedia、C4、The Pile 的 GitHub子集三个数据集上,使用 32 个预老师模子(范围从数百万到数百亿参数),系统查考了交叉熵偏执三个明白要素随模子范围的变化趋势。

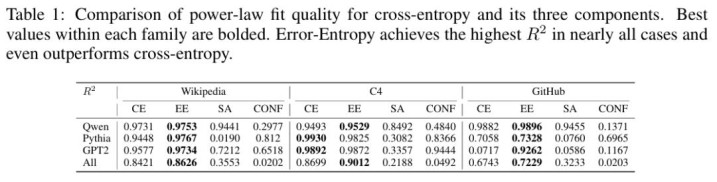

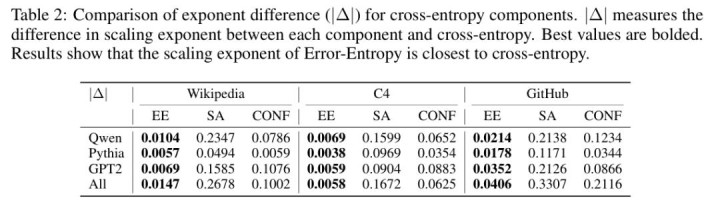

成果绝顶了了:在对数-对数坐标下,罪状熵呈现接近线性的着落趋势,与模子参数目之间存在郑重的幂律联系。

与之相背,自对都项在模子增大时莫得改善,反而微小飞腾;置信度项则波动较大,穷乏一致的变化端正。

研究者由此忽视了「罪状熵范围定律」(Error-Entropy Scaling Law):在交叉熵的三个要素中,只须罪状熵委果征服幂律缩放。

定量拟合的成果进一步考证了这一论断。论文使用法度幂律模子对各要素进行拟合后发现,罪状熵的拟合优度在所稀有据集上均权贵高于交叉熵本人。这讲解交叉熵之是以「看起来像」在缩放,本体上是因为罪状熵在驱动举座趋势,而自对都和置信度带来的噪声减轻了拟合精度。

破解大模子范围定律失效之谜

研究者运用这一发现回应了滥觞忽视的缺点问题:交叉熵范围定律为什么在大模子上失效?

谜底藏在三个要素的比例结构中。在小模子中,罪状熵占据了交叉熵总量的近 90%。由于罪状熵征服幂律,举座交叉熵当然也发达出邃密的幂律趋势。

可是跟着模子范围增大,罪状熵占总亏空的比例渐渐着落,而不征服缩放端正的自对都和置信度项占比相应飞腾。关于大模子来说,交叉熵中有越来越大的比例来自不缩放的要素。

这些不缩放的要素像是重复在幂律趋势上的“噪声地板”,使得交叉熵偏离了简约的幂律展望。模子越大,偏差越权贵——这恰是业界不雅察到的"范围定律失效"时局。

罪状熵的启发

除了讲解注解范围定律的失效机制,这一研究也为推行和表面带来了新的可能。

在老师层面,既然罪状熵才是委果随范围改善的要素,那么平直以罪状熵手脚老师信号或评估策画,粗略比交叉熵能更准确地反馈模子才智的擢升,从而率领更高效的老师计谋和资源分派。

在表面层面,这一明白揭示了一个更深层的原则:模子范围的增长本体上擢升的是排序才智,而非概率校准才智。这粗略能为清楚大模子的才智界限和优化标的提供新的率领。

更多细节请参阅原论文比赛下注app。

IM体育官方网站首页